生成AIは調べ物や文章作成を助ける心強いツールとして、ビジネスから日常生活まで幅広く活用されています。

しかし、検索の手間を減らしたり、文章を短時間でまとめたりと、多くの場面で役立つ一方で、事実と異なる内容を示す場合もあり、「嘘ばかり」と感じるケースも少なくありません。

生成AIは、なぜ間違えるのでしょうか。

実際にはAIが意図的に嘘をついているのではなく、学習データの更新範囲が限られていたり、質問に含まれる前提があいまいだったりすることで誤答が生じてしまいます。

さらに、Web上の誤った情報を放置しておくと、Googleの「AIモード」によってその内容が引用・生成され、誤答がさらに拡散される可能性もあるでしょう。

そこでこの記事では、生成AIが誤った答えを出す理由や典型的な例を紹介し、安心して活用するための工夫や対策をわかりやすく解説します。

関連記事

・風評被害対策は事前準備が大切!受ける影響や事例とともに効果的方法を解説

・「実名+詐欺師」の検索結果を非表示に!H様の逆SEO対策成功事例を紹介

・【2026年最新】風評被害対策サービス会社のおすすめ20選を徹底比較

「サジェスト/関連ワードを非表示に」サジェスト対策の詳細はこちら

「悪質サイトの検索順位を下げる」逆SEO対策の詳細はこちら

コンテンツ目次

- 1 ChatGPTは嘘をつく?AIが誤答をする原因・理由

- 2 ChatGPTなどの生成AIによる嘘・誤答がもたらす個人への悪影響

- 3 ChatGPTなどの生成AIによる嘘・誤答がもたらす企業・団体への悪影響

- 4 ChatGPTなどの生成AIによる嘘・誤答を完全になくす方法はある?

- 5 ChatGPTなどの生成AIは検索上位の情報を参考にすることも

- 6 ChatGPTなどの生成AIによる嘘・誤答が広まってしまったときの対策

- 7 ChatGPTなどの生成AIによる嘘・誤答に備えるならアクシアカンパニーへ

- 8 ChatGPTなどの生成AIによる嘘・誤答を減らす方法

- 9 ChatGPTなどの生成AIによる嘘・誤答の典型例

- 10 「ChatGPT 嘘」「AI 誤答」に関するよくある質問

- 11 ChatGPTなどの生成AIによる嘘・誤答対策まとめ

ChatGPTは嘘をつく?AIが誤答をする原因・理由

ChatGPTをはじめとする生成AIは便利な一方で、嘘が多いと感じられる場面や、間違いが多いと指摘されるケースも少なくありません。

その背景には、下記のような複数の要因があります。

- ハルシネーションが生じるため

- 学習データが不完全か偏りがあるため

- プロンプト設計(質問文)に問題があるため

生成AIは、ときに嘘の情報をもっともらしく提示してしまうこともあり、利用者が誤った判断をしてしまう危険性があるので注意が必要です。

ここからは、生成AIがなぜ誤答を生みやすいのか、その原因を整理して解説します。

ハルシネーションが生じるため

生成AIが誤った答えを出してしまう大きな原因のひとつに「ハルシネーション」があります。

ハルシネーションとは、AIが根拠のない内容を、まるで本当の情報であるかのように自然で説得力のある文章として生成してしまう現象のことです。

ChatGPTのような生成AIは膨大な文章データを学習し、その中から「次に来る言葉」を確率的に選んで答えを作ります。

そのため、情報が不足していたり曖昧だったりする場面でも、あたかも正しいかのように文章を組み立ててしまうことがあります。

こうしたハルシネーションをそのまま信じてしまうと、誤った判断につながりかねません。

実際にアメリカでは、弁護士がChatGPTの出力した存在しない判例を裁判で引用し、処分を受けるという事例も報じられています。

参照:日経新聞

このように文章が自信ありげに見えるほど、誤情報に気づきにくい点が危険だと言えます。

ハルシネーションは生成AIにとって避けられない現象であり、利用する際には「自然な文章でも誤りが含まれているかもしれない」と意識し、一次情報や公的資料で必ず確認することが欠かせません。

学習データが不完全か偏りがあるため

AIが出す回答の質は、学習に使われたデータの質に大きく左右されます。

AIはインターネット上の膨大な文章をもとに学習しているため、情報源に古い内容や誤った記述が含まれていると、そのまま誤答につながる可能性があるのです。

また、特定の文化や言語に偏ったデータが多い場合や、少数しかサンプルが存在しないテーマについては、偏った見解や不正確な答えが出やすくなります。

特に医療や法律のように専門性が高い分野や、日々更新される速報ニュースなどでは正確な情報を学習しきれていないことがあり、間違った内容を提示してしまう危険性が高まります。

さらに、インターネット上には信頼性の低い情報も多く、それらを学習したAIが引用してしまうことも珍しくありません。

つまり、学習データが不完全であったり偏っていたりする限り、AIの回答には一定の誤りが避けられないのです。

プロンプト設計(質問文)に問題があるため

AIが誤った答えを出す原因のひとつに、質問文の作り方、いわゆるプロンプト設計の問題があります。

問いがあいまいだったり、背景情報が不足していたりすると、AIは不確かな推測で内容を補おうとするため、結果として間違いだらけの回答になる場合があるのです。

例えば「おすすめのレストランは?」とだけ尋ねても、地域や予算、好みなどの条件が明確でなければ的外れな答えになりがちです。

生成AIは与えられた入力の影響を強く受けるため、質問の精度が出力の正確性に直結します。

例えば、AIで医療に関する相談をした場合、症状や前提条件が省略されていたことで不適切な回答が返ってくることなども想定されるでしょう。

そのため、AIに任せる前に質問をできるだけ具体的にし、必要な情報を補って伝えることが重要です。

利用者が意識して質問文を設計するだけで、回答の質は大きく改善され、誤答のリスクも軽減できるでしょう。

ChatGPTなどの生成AIによる嘘・誤答がもたらす個人への悪影響

ChatGPTをはじめとする生成AIは役立つ場面が多い反面、間違った情報をもっともらしく提示してしまうことがあります。

こうした誤答は、下記のような悪影響につながる可能性があるでしょう。

- 人間関係に亀裂が生じる

- 就職・キャリアへの打撃が生じる

- 誹謗中傷や嫌がらせを受ける

- 金銭的な損失が現れる

最近は、Google検索結果と並んで表示されるAIの回答を参考にする人も増えていますが、裏付けのない情報をそのまま信じてしまうと深刻なリスクを抱えることになるのです。

ここからは、生成AIの間違った情報から生じる個人への悪影響について詳しく解説します。

人間関係に亀裂が生じる

生成AIの誤答や虚偽の情報は、個人の人間関係に深刻な影響を及ぼす可能性があります。

特に「詐欺」や「犯罪」など事実無根の内容がAIの出力を通じて拡散すると、本人の信用は大きく損なわれてしまうでしょう。

その結果、家族や友人との間に不信感が生まれたり、職場の同僚や上司から疑念を持たれたりするなど、周囲との関係に亀裂が生じかねません。

誤情報の拡散は社会的孤立や心理的ストレスを強める要因となり、信頼回復には長い時間が必要となってしまいます。

例えば、SNS上でAIが生成した誤った噂が広がり、後に虚偽と判明しても「火のない所に煙は立たぬ」といった印象が残り、人間関係に修復困難な傷を残すケースも想定されるでしょう。

就職・キャリアへの打撃が生じる

生成AIが生み出した誤情報は、就職やキャリア形成にも大きな打撃を与える可能性があります。

特に「ネット上の誤情報を企業の採用担当者が見て、採用選考に不利になる」というリスクは無視できません。

実際に、企業の多くが採用時に応募者のオンライン情報を確認していることが明らかになっています。

そのため、事実無根の経歴や不適切な発言がAIの誤答として拡散されると、面接以前の段階で評価が下がってしまう恐れがあるでしょう。

例えば、ChatGPTやGoogleのAIモードなどで当事者について質問した際、「逮捕」や「反社」といった根拠のない虚偽情報が生成・表示されてしまう場合もあります。

こうした情報が一度ネット上に出回ると、採用担当者や取引先が事前調査で目にする可能性が高まり、企業側がリスクを避けるために採用や契約を見送る判断を下す恐れもあるでしょう。

誹謗中傷や嫌がらせを受ける

生成AIによる誤答や虚偽の情報は、個人が誹謗中傷や嫌がらせを受けるきっかけにもなり得ます。

AIが事実と異なる内容を「正しい情報」のように生成し、それがSNSや掲示板などで拡散すると、本人の意図とは無関係に名誉が傷つけられる恐れもあるでしょう。

インターネット上の誹謗中傷は深刻な社会問題であり、被害者が強い精神的ストレスを抱え、結果的に心身に悪影響が生じるケースが多いと指摘されています。

例えば、AIが生成した虚偽の発言や犯罪関与のような誤情報が拡散され、本人が実際には無関係であっても、周囲からの誤解や攻撃につながる恐れもあるでしょう。

こうした被害は仕事や人間関係にも波及し、生活全体を揺るがしかねません。

金銭的な損失が現れる

生成AIの誤答は、個人に直接的な金銭的損失をもたらす危険もあります。

AIが誤った内容をもっともらしく提示し、それが信じられてしまうと、仕事や取引に悪影響が及ぶ可能性があるのです。

例えば、誤情報が原因で仕事の依頼が減ったり、フリーランスの場合は契約が取り消されたりすることも現実に起こり得ます。

また、投資や金融に関する誤答を信じてしまった結果、誤った判断で大きな損失を出すケースも想定されるでしょう。

AIが生成した誤情報に基づいて株価変動が一時的に起きる可能性もあり、経済的な影響にもつながる場合も考えられます。

ChatGPTなどの生成AIによる嘘・誤答がもたらす企業・団体への悪影響

AIは便利なツールですが、間違った情報を自然に生成してしまうことがあり、それが企業や団体に深刻な影響を及ぼすことがあります。

誤答が広まると、下記のようなリスクに直結してしまうので注意が必要です。

- 売上・顧客離れが発生する

- 採用活動に悪影響が生じ従業員の士気が下がる

- 株価が下落し投資家の信頼を失う

- 対応コストが増大する

- 誤情報がネット上に残り続ける

ここからは、生成AIによる虚偽情報が組織にもたらす具体的な悪影響について解説します。

関連記事

・風評被害対策は事前準備が大切!受ける影響や事例とともに効果的方法を解説

・「実名+詐欺師」の検索結果を非表示に!H様の逆SEO対策成功事例を紹介

・【2026年最新】風評被害対策サービス会社のおすすめ20選を徹底比較

売上・顧客離れが発生する

生成AIが生み出す誤答や虚偽の情報は、企業にとって深刻なリスクとなり、売上減少や顧客離れを引き起こす要因になり得ます。

特にネガティブな誤情報は、製品やサービスに対する購買意欲を低下させ、収益の落ち込みにつながる点が懸念されるでしょう。

消費者はインターネットで得た情報を購買判断に強く反映する傾向があり、誤情報の拡散は経済活動全体に影響を及ぼしかねません。

例えば食品業界での根拠のない安全性への疑念がSNSで広まり、一時的に売上が大幅に減少することも考えられるでしょう。

こうした誤情報は事実確認よりも早く拡散され、企業が公式に訂正を行っても、不信感はすぐには解消されません。

結果として売上だけでなくブランドイメージの毀損にも直結します。

採用活動に悪影響が生じ従業員の士気が下がる

生成AIによる誤答や虚偽の情報は、企業の採用活動や従業員の士気に大きな影響を及ぼします。

風評被害によって企業の印象が悪化すると応募者数が減り、人材獲得に支障をきたす恐れもあるでしょう。

例えば、AIが生成した誤った企業情報や存在しない不祥事がSNSで拡散された場合、就職希望者が急減する可能性も考えられます。

さらに社内でも「自社が不当に評価されている」という不安が広がり、モチベーションの低下や離職につながるリスクがあります。

このように、誤情報は採用面だけでなく組織全体の安定性を揺るがす要因となってしまうのです。

関連記事:採用に直結!企業の口コミに人事担当ができる風評被害対策

そのため企業は、誤情報を早期に発見して修正する仕組みを整えると同時に、社内外へ正しい情報を迅速に発信し続ける体制を持つことが欠かせません。

株価が下落し投資家の信頼を失う

株式市場は情報に非常に敏感であり、誤った内容が一度広がるだけで企業に深刻な影響を及ぼします。

投資家は企業の将来性や信頼性をもとに判断を下すため、真偽が確認されていないニュースでも不安が高まり、売り注文が先行して株価が急落することがあるのです。

株価が下がれば企業の評価も低下し、資金調達コストの上昇や事業展開の制約につながります。

このように、誤情報の拡散は市場の健全性を揺るがす要因になりかねません。

例えば、AIが生成した架空の企業合併ニュースがSNSで拡散することで、一時的に株価が大きく乱高下する、などの事態も想定されます。

こうした状況はブランド価値や投資家との信頼関係にも直結するため、企業には迅速に誤情報を修正し、正しい情報を発信できる体制づくりが求められています。

対応コストが増大する

誤った情報が広まると、企業はその収束や信頼回復のために大きなコストを負担することになります。

事後対応だけでなく、予防のための投資も必要となり、経営資源を圧迫するリスクは少なくありません。

具体的には、以下のような出費が想定されます。

- PR対応や謝罪会見の準備

- 法務手続きや弁護士費用

- 訂正記事や広告の出稿

- SNSや検索結果を監視する体制の強化

- AIを活用したモニタリングシステムの導入

- 風評被害対応を担う専門部署の設置

生成AIの誤答による影響を最小限に抑えるには、平時から正確な情報発信と迅速な訂正を行える仕組みを整えておくことが不可欠です。

誤情報がネット上に残り続ける

生成AIが生み出した誤答や虚偽の情報は、一度ネット上に広がると削除が難しく、企業や団体に長期的な悪影響を及ぼす可能性があります。

インターネットは拡散速度が非常に速く、記事やSNSの投稿は瞬時に共有されます。

そのため、後から誤りを訂正しても、元の情報がキャッシュやまとめサイト、個人ブログなどに転載され、完全に消し去ることはほぼ不可能です。

さらに、GoogleのAIモードにも誤った情報が残り続ける可能性があり、検索や質問を通じて再び広まってしまうこともあります。

結果として、古い誤情報が何度も参照され、企業の評判を長期的に傷つけるリスクにつながるのです。

そして、たとえ訂正を行ったとしても、誤った内容だけがSNS上で一人歩きし続け、信頼回復に長い時間を要する事態も十分に考えられるでしょう。

関連記事:デマによる風評被害はなぜ起こる?罪になる?原因と対策を解説

このように誤情報は「消えにくい負債」となり、ブランド価値をじわじわと損なうため、発生直後から迅速かつ継続的に対応する姿勢が欠かせません。

ChatGPTなどの生成AIによる嘘・誤答を完全になくす方法はある?

生成AIはときに誤った答えを返すこともありますが、「嘘をつかせない方法」はあるのでしょうか。

結論として、嘘や誤答を完全にゼロにすることはできません。

ChatGPTやGeminiといった生成AIは、大量の文章データを学習し、そのパターンからもっともらしい答えを作る仕組みです。

つまり「事実かどうか」よりも「自然で一貫性のある文章」を優先して出力する特徴があります。

そのため、古い情報を使ったり、存在しない参考文献を示したりすることで、誤回答が生まれるのです。

しかし、工夫をすることで間違いを減らせます。

質問をできるだけ具体的にする、出典を求める、複数の回答を比べる、最新の公式データで確認するといった方法が有効だと言えるでしょう。

生成AIの嘘を完全になくすのは難しいですが、利用者が意識して工夫することで誤答を大幅に減らし、安心して活用できるようになります。

ChatGPTなどの生成AIは検索上位の情報を参考にすることも

ChatGPTなどの生成AIは、通常は膨大な学習データをもとに回答を生成しますが、最新情報を取得する際には検索エンジンの結果を参考にすることもあります。

そのため、検索上位にネガティブな情報や誤った内容が掲載されている場合、AIがそれを引用・要約して出力してしまう可能性があります。

特に企業名や個人名で検索した際に、誹謗中傷や炎上記事などが上位にあると、AIによる回答や要約結果にも影響を及ぼす恐れがあります。

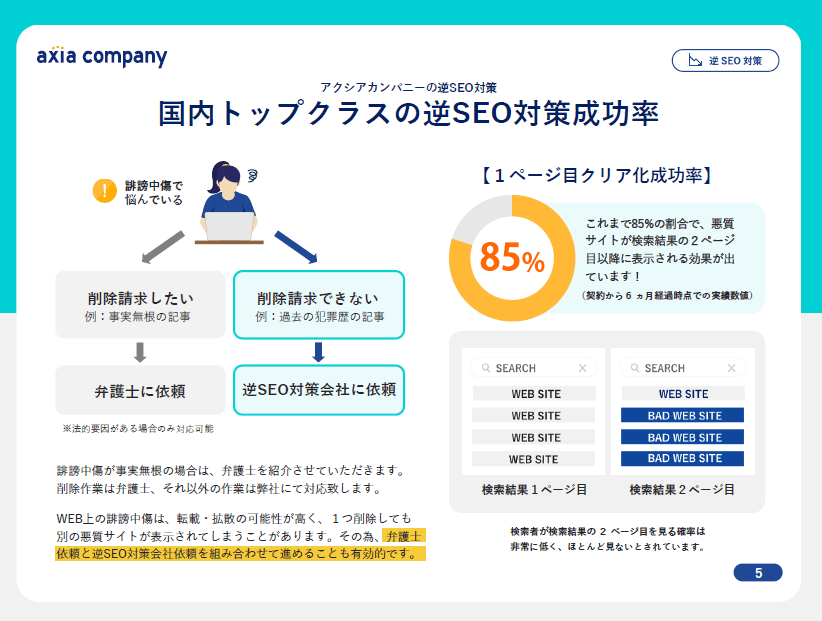

このような状況を防ぐには、問題のある記事を削除依頼するか、逆SEOによって検索順位を圏外に押し下げるといった対策が有効である場合があります。

株式会社アクシアカンパニーでは、これまで培ってきた逆SEO対策やサジェスト対策のノウハウを活かし、検索結果や候補表示におけるネガティブ情報の抑制・改善が可能です。

また、サジェスト(検索候補)に不適切な語句が出る場合でも、それを抑制・置き換える施策を講じることで、検索から生じる誤解や印象悪化を未然に防げます。

ChatGPTなどの生成AIによる嘘・誤答が広まってしまったときの対策

誤情報は放置すればするほど影響が広がり、信用や評判の回復が難しくなるため、下記のような点を意識して、早めに行動することが重要です。

- 誤情報の拡散経路を特定し削除依頼や通報を行う

- 公式声明や正しい情報を迅速に発信する

- 名誉毀損や風評被害が深刻な場合は法的措置を検討する

- 風評被害対策の専門業者に相談する

ここからは、生成AIが生み出した嘘や誤答が拡散してしまった際に取るべき具体的な対応策を紹介します。

関連記事

・風評被害対策は事前準備が大切!受ける影響や事例とともに効果的方法を解説

・「実名+詐欺師」の検索結果を非表示に!H様の逆SEO対策成功事例を紹介

・【2026年最新】風評被害対策サービス会社のおすすめ20選を徹底比較

誤情報の拡散経路を特定し削除依頼や通報を行う

誤情報が広まってしまった場合には、早急な対応が欠かせません。

放置すると内容が事実のように扱われ、個人や企業の信用に長期的な損害を与える恐れがあるためです。

特にインターネット上では拡散のスピードが早く、訂正が遅れるほど被害が拡大する可能性もあるでしょう。

対応の基本的な流れは以下のとおりです。

| 拡散経路を特定する | SNS、掲示板、検索結果などを調べ、どの媒体で誤情報が拡散しているのかを正確に把握する |

| 証拠を確保する | 後の削除依頼や法的対応に備え、スクリーンショットやURL記録などを残しておく |

| 各サービスへ削除申請する | X(旧Twitter)、Instagram、Google検索、口コミサイトなどのガイドラインに基づき、適切に削除依頼や通報を行う |

必ずしも全ての申請が通るわけではありませんが、虚偽の口コミについて証拠をもとに申請すれば、削除が認められる可能性もあります。

こうした手続きには時間や労力がかかりますが、拡散経路の特定と適切な申請は被害を最小限に抑える効果的な方法と言えるでしょう。

公式声明や正しい情報を迅速に発信する

誤情報が広まった場合、最も効果的な対応のひとつは自社サイトや公式SNSで正しい情報を迅速に発信することです。

情報を放置すると誤解が拡大し、信頼回復が難しくなる恐れがあります。

特にネット上では情報の拡散速度が非常に速く、数時間で大規模に共有されてしまうことも珍しくありません。

そのため、初動の遅れは致命的となります。

しかしSNS上で誤った製品不具合の情報が広がった際に、企業が即座に公式声明を出して正しい内容を示せば、混乱や不安の拡大を最小限に抑えられる可能性が高まるでしょう。

正確な情報を示すことは、顧客や取引先の安心につながり、ブランド価値の維持にも効果的です。

誤情報に対抗するためには、迅速かつ透明性のある公式発信を徹底することが不可欠であり、広報体制の強化が今後ますます重要になります。

名誉毀損や風評被害が深刻な場合は法的措置を検討する

生成AIによる誤答や虚偽の情報が名誉毀損や深刻な風評被害につながった場合、弁護士に相談して削除請求や損害賠償請求など法的手段を検討することが重要です。

特に企業や個人の社会的信用が失われると、売上減少や取引停止など経済的な影響に直結するため、迅速な対応が求められます。

インターネット上の誤情報は被害者の生活や事業基盤を脅かすリスクがあるため、しっかり対応しましょう。

被害が深刻化する前に専門家の助言を得て、削除請求や発信者情報開示請求を行うことは有効な手段です。

関連記事:弁護士と風評被害対策会社への削除と対策の違い~費用やメリットを解説

誤情報を放置せず、必要に応じて法的措置を講じることで、信頼回復と再発防止につなげることができるでしょう。

風評被害対策の専門業者に相談する

生成AIによる誤答や虚偽情報が広がった場合、個人や企業が独力で誤情報を抑えるのは難しいため、風評被害対策の専門業者に相談することが有効です。

インターネット上の情報は検索結果やSNSで拡散され続ける特性があり、一度広まった内容を自力で削除・抑制するのは現実的に困難です。

そこで、専門業者による逆SEO、サジェスト対策、口コミ対策などを活用することで、検索結果の上位から誤情報を押し下げたり、ネガティブな関連ワードを減らすことができます。

詳細はこちら:SEO対策と逆SEO対策の違いとは?自分でできる方法や業者の選び方も解説

詳細はこちら:サジェスト汚染とは?Google・Yahoo・Bingでの原因と対策方法を解説

専門業者への依頼は、弁護士による法的対応に比べ、即効性やコスト面でメリットがある点も特徴です。

被害を最小限に抑えるためには、早期に専門業者のサポートを受けることが効果的な手段だと言えるでしょう。

ChatGPTなどの生成AIによる嘘・誤答に備えるならアクシアカンパニーへ

生成AIが生み出した誤情報によって、SNSや検索結果にネガティブな情報が広がると、企業や個人の信頼が揺らぎ、ビジネスや生活に深刻な影響を及ぼすことがあります。

アクシアカンパニーでは、逆SEO対策・サジェスト対策・口コミ対策を組み合わせた総合的な施策を提供しており、単発的な削除依頼にとどまらず、長期的に風評被害を軽減できる体制づくりを支援しています。

検索結果や関連キーワードに表示される誤情報を目立たなくするだけでなく、適切な情報発信とあわせて、健全なブランドイメージの維持につなげられる点が強みです。

また、豊富な実績と専門的なノウハウをもとにした提案が可能で、匿名での問い合わせや無料相談にも対応しているため、初めてでも安心して相談していただけます。

AI時代のリスク対策を進めるうえで、安心して頼っていただけるパートナーとして、しっかりサポートいたします。

関連記事:ネガティブサイトの代わりに正確な情報を上位表示!株式会社I様の逆SEO対策の実例

ChatGPTなどの生成AIによる嘘・誤答を減らす方法

生成AIは幅広い分野で活用できる一方、誤った情報をまるで本当かのように示してしまうリスクもあります。

完全に防ぐことは難しいものの、下記のような工夫により、できるだけ嘘をつかないようにすることは可能です。

- 質問を具体的にする(プロンプトを明確化する)

- 出典や参考文献の提示を求める

- 複数の回答を比較・検証する

- 最新データを併用して確認する

質問を具体的にする(プロンプトを明確化する)

生成AIの誤答を減らすためには、質問文をできるだけ具体的にしましょう。

その理由は、AIは曖昧な指示を与えられると不確かな推測を補おうとし、誤情報を提示する危険があるからです。

例えば「最近の法律改正について」と尋ねるよりも「2025年1月施行の労働基準法改正について」と条件を明確にすると、回答の精度が高まります。

さらに、日時・対象・条件を具体的に設定するほか、参考にすべきURLを一緒に入力することで、正確な情報に基づいた回答を得やすくなるでしょう。

加えて、チャットGPTなどで「ハルシネーションしないで」とプロンプトに記載することで、不正確な内容を抑制できる場合もあります。

このように、質問を工夫して明確化することが、ハルシネーションのリスクを下げ、より実用的で信頼性のある回答を得るための有効な方法となるでしょう。

出典や参考文献の提示を求める

生成AIの嘘や誤答を減らすには、回答に出典や参考文献を示すよう求めることが効果的です。

AIは情報源を持たない場合もありますが、指定すれば関連資料を提示することがあり、その有無を確認するだけでも信頼性の判断材料になります。

例えば「出典を示してください」「どの資料に基づいていますか」と問いかければ、回答の裏付けがあるかどうかを見極めやすくなるでしょう。

特に医療や法律のように正確さが求められる分野では、出典の明示が誤情報対策に直結します。

自治体や大学の研究機関が公開している調査データを出典に含めた回答を参照することで、情報の信頼度が増すでしょう。

一方で、出典が不明確な場合は、その回答をそのまま利用せず、必ず人間が検証することが重要です。

こうした工夫により、ChatGPTなどの生成AIを安全に活用しやすくなります。

複数の回答を比較・検証する

生成AIの回答をそのまま受け取るのではなく、複数のパターンを比較して検証することが誤答を減らすために有効です。

AIは質問の仕方によって答えが変わる特性を持つため、一度の回答に依存せず、同じ内容を言い回しを変えて何度か尋ねると矛盾点や誤りを発見しやすくなります。

また、ChatGPTとGeminiなど異なるAIの回答を並べて比較することも有効な方法です。

複数の視点から情報を得ることで、どの部分に共通性があり、どの部分が不確かなのかを見極めやすくなります。

さらに、公的機関や信頼できるサイトで裏付けを取ることで、誤情報に基づく判断を避けることができます。

このように、AIの答えを比較・検証する習慣を持つことで、情報の正確性を高めながら安心して活用できるようになるでしょう。

最新データを併用して確認する

生成AIの誤答を減らすために、常に最新の情報と照らし合わせるように心がけましょう。

AIは過去のデータをもとに学習しているため、学習時点以降に起きたニュースや制度改正、最新統計には対応できません。

そのため、回答を鵜呑みにせず、Google検索や公式サイトなどで最新情報を確認することが重要です。

例えば「最低賃金の金額」をAIに尋ねると古い年度の水準を示す場合があり、実際の資料作成や記事執筆などでそのまま使うと誤情報につながります。

特に金融、医療、法律のように日々情報が更新される分野では、必ず信頼できる一次情報と突き合わせる必要があります。

AIを活用する際は「回答を参考にしつつ、必ず最新の公式データで確認する」という習慣を持つことが、誤答を避ける最も有効な方法と言えるでしょう。

ChatGPTなどの生成AIによる嘘・誤答の典型例

生成AIは便利で多くの場面で活用されていますが、下記のように誤回答をもっともらしく提示してしまう危険性があります。

- 架空の引用・論文・判例を作成してしまう

- 前提が誤っている質問に対して間違った結論を出す

- 最新事情を反映せず古い(誤った)データをもとに答えてしまう

間違いの例は多岐にわたり、利用者がそのまま受け取ってしまうと、風評被害や誤解の拡散につながりかねません。

そのため、典型的な誤答のパターンを知っておくことが重要です。

架空の引用・論文・判例を作成してしまう例

生成AIの誤答の中でも特に問題となるのが、実在しない参考文献や判例をあたかも本物のように提示してしまうケースです。

ChatGPTは過去のデータをもとに自然な文章を組み立てますが、情報が不十分なときに補完しようとして、存在しない学術論文や判例を生み出すことがあります(ハルシネーション)。

下記の事例のように、もっともらしく見える嘘の情報が紛れ込むことで、混乱を招いてしまうというわけです。

- 架空の学術論文を「権威ある研究」として出典提示

- 実際には存在しない判例を「最高裁で確定」と断言

- 出典URLを示すが、クリックするとエラーページに飛ぶ

- 実在する論文タイトルと著者名を組み合わせた“嘘の文献”を提示

- 国際的な学会で発表されたとされるが、確認できない発表記録

- 存在しない法律改正を「2023年に施行」と説明

- 著名な研究者の名前を出すが、本人はその分野に関与していない

AIが示す出典は必ず実際に検索やデータベースで確認し、公式の法令集や学術機関の公開情報と照合するようにしましょう。

前提が誤っている質問に対して間違った結論を出す例

生成AIは質問文を前提として答えを導く仕組みのため、質問自体に誤りが含まれていると、そのまま誤答を出す危険があります。

例えば「源頼朝と織田信長は同じ時代に活躍した武将ですか?」という質問に対し、本来は時代が異なるため成立しないにもかかわらず、AIが「はい」と答えてしまうケースが挙げられます。

これはタイムラインや歴史的事実の誤りを修正できず、もっともらしい説明を続けてしまう「典型的な誤答」です。

特に学術的な分野や教育現場では、こうした誤りが誤解を広げかねません。

このような誤答を避けるには、利用者が質問の前提に誤りがないか確認することが重要です。

また、AIの回答は必ず信頼できる史料や公式データと照合し、間違った結論を鵜呑みにしない姿勢が求められます。

最新事情を反映せず古い(誤った)データをもとに答えてしまう例

生成AIは学習時点でのデータを参照しているため、更新が止まっていると最新事情を反映できず、古い情報をそのまま参考にしてしまうリスクがあります。

特に法律改正や医療ガイドライン、最新ニュースは日々変化しており、古い情報を引用することは誤解や実害につながりかねません。

例えば「最新の労働基準法改正」について尋ねても、改正前の条文を正解として示す場合があります。

その他にも、下記のような事例があるので注意が必要です。

- すでに改訂された治療指針を反映せず、古い薬剤や非推奨の治療法を「有効」と説明する

- 廃止された助成金制度や補助金を「利用可能」と誤って案内し、利用者に混乱を招く

- 2010年代の古い国勢調査や人口推計を「最新」と提示し、実際の2020年代の統計と大きく乖離する

- 金利や税制が変更されているにもかかわらず、過去の条件で住宅ローンや控除の説明を行う

このような問題を避けるには、ChatGPTの回答を参考にしつつ、必ず政府機関や公的統計サイトなど信頼できる一次情報と照合することが欠かせません。

生成AIを利用する際には、常に「最新データを確認する」という意識を持つことが、誤答のリスクを最小限に抑える方法だと言えるでしょう。

「ChatGPT 嘘」「AI 誤答」に関するよくある質問

Yahoo!知恵袋やSNSでも話題になるように、生成AIの誤答に関する疑問は多く寄せられています。ここからは、特によくある質問に答えていきます。

ChatGPTなどの生成AIによる嘘・誤答対策まとめ

ChatGPTなどの生成AIは文章作成や調べものにとても便利なツールですが、ときに事実とは違う答えや誤った情報を示してしまうことがあります。

こうしたリスクを完全にゼロにすることは難しいため、利用する側が工夫して精度を高める姿勢が大切です。

具体的には、質問をできるだけ明確にする、出典を求める、複数の回答を比較する、さらに最新の統計や公式情報を参照するなどの方法が有効です。

そして、生成AIが間違った情報を出してしまうと、それが広がって個人や企業の信頼を傷つける危険があります。

場合によっては削除依頼や公式の説明、さらには法的な対応が必要になることもあるでしょう。

こうした対応は時間や労力がかかるため、状況により風評被害対策を専門とする業者に相談するのも安心につながります。

工夫と備えを組み合わせて、AIの便利さを活かしつつ、信頼できる使い方を心がけましょう。

#chat gpt 嘘 #ai 誤答

逆SEO対策

逆SEO対策 サジェスト対策

サジェスト対策 SEO対策

SEO対策 MEO対策

MEO対策 ホームページ制作

ホームページ制作

アクシアカンパニーの

企業リスク対策で売上・採用・ブランディングを守ります。

弊社は逆SEO・サジェスト共に高い成果率を誇ります。お客様の課題を明確にし早期解決致します。

事前調査&お見積り